Corsários do Silício: o escândalo do treinamento de IAs com livros pirateados

Em 2023, a Meta baixou ilegalmente 81,7 terabytes de materiais para treinar o bot LLaMA. É um crime? Não há consenso. Entenda as zonas jurídicas cinzentas inauguradas pela IA.

o início de abril, um grupo de manifestantes se reuniu em frente ao escritório da Meta em Londres. Eles carregavam cartazes que chamavam a dona do Facebook de ladra e pediam justiça e compensação monetária. Em um deles, lia-se: “Eu até escreveria uma placa melhor, mas vocês a roubariam”.

Eram todos escritores, que protestavam contra o uso de arquivos pirateados de seus livros para treinar uma IA chamada Large Language Model Meta AI – a sigla é LLaMA, um trocadilho com o animalzinho lanudo dos Andes. Trata-se de um grande modelo de linguagem (LLM), do mesmo tipo que os conhecidos GPTs da OpenAI.

Tudo começou em janeiro, quando vieram à tona documentos de um processo judicial iniciado em 2023 por um grupo de sete autores americanos. A papelada revelou que a Meta treinou o LLaMA com o repositório da Library Genesis (LibGen) – uma biblioteca online ilegal que funciona como o PirateBay do mercado editorial: o acervo contém 81 milhões de artigos científicos, 4,6 milhões de livros, 2 milhões de HQs e 400 mil revistas. Ao todo, esses e outros conteúdos protegidos por copyright totalizavam 81,7 terabytes (TB) de informação.

Os LLMs funcionam como o jogo da cobrinha: quanto mais comem informação, maiores e mais poderosos ficam. Quando esses softwares estão escrevendo um texto, eles preveem qual deve ser a próxima palavra com base nos termos que costumam aparecer em trechos similares de outros textos. Portanto, quanto mais conteúdo for usado para treiná-los, melhor o resultado. Daí a importância de usar livros.

Uma equipe de pesquisadores do MIT e da Universidade Cornell estudou recentemente o valor de vários tipos de material textual para o aprendizado de máquina. A conclusão foi que os livros apresentaram “os efeitos positivos mais fortes no desempenho posterior”, são comparativamente “muito mais abundantes” do que outras fontes e contêm o material “mais longo e legível”, com “frases significativas e bem editadas”.

É claro: escritores e editores profissionais produzem bons textos, melhores que os disponíveis gratuitamente online. Mas conseguir autorização para usar esse conteúdo é caro e demorado – daí a tentação de baixar tudo por debaixo dos panos, e tentar a sorte na Justiça depois. Para piorar o vexame, há indícios de que Mark Zuckerberg em pessoa teria aprovado o uso do material pirateado, apesar da hesitação entre funcionários da empresa.

Em uma das conversas recuperadas de computadores da Meta, um colaborador jocoso comenta que “fazer torrents de um laptop corporativo não parece certo”. O diálogo segue com uma discussão sobre como o assunto teria chegado nas mãos de um certo MZ – as iniciais do CEO –, que deu sinal verde para os downloads (oficialmente, Zuck nega qualquer envolvimento).

A Meta não está sozinha nessa. Um outro processo, movido pelo mesmo grupo de escritores, acusa a Open AI de Sam Altman, criadora do ChatGPT, de utilizar os arquivos da LibGen. Esses casos demoram para vir à tona porque a grande maioria das empresas do ramo, por razões evidentes, impede que o público e a concorrência acessem código-fonte, métodos de treinamento, bases de dados etc.

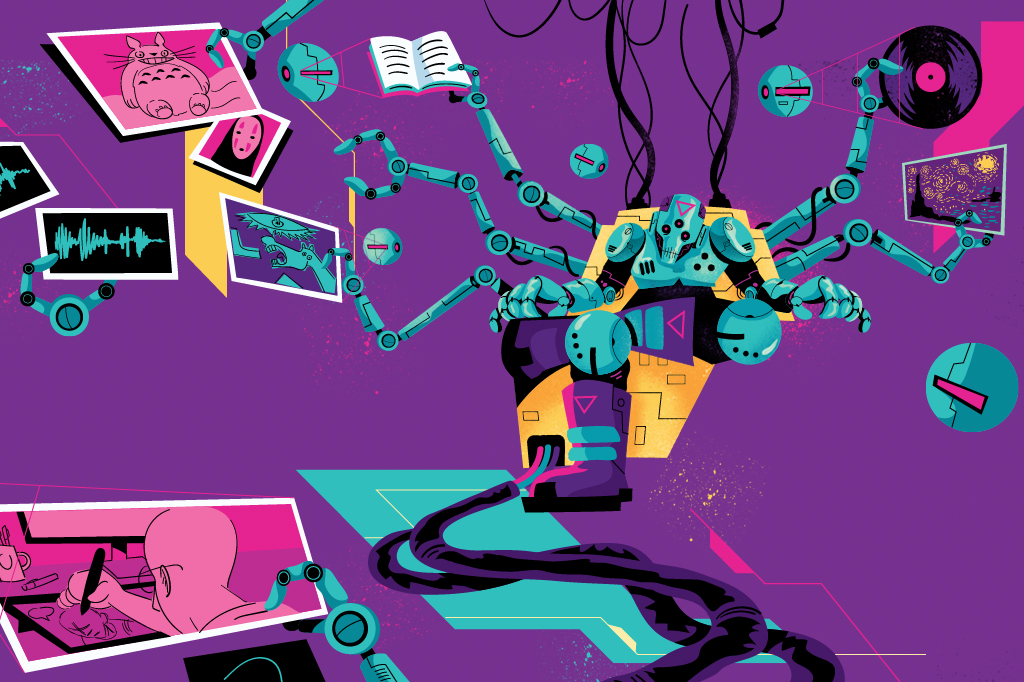

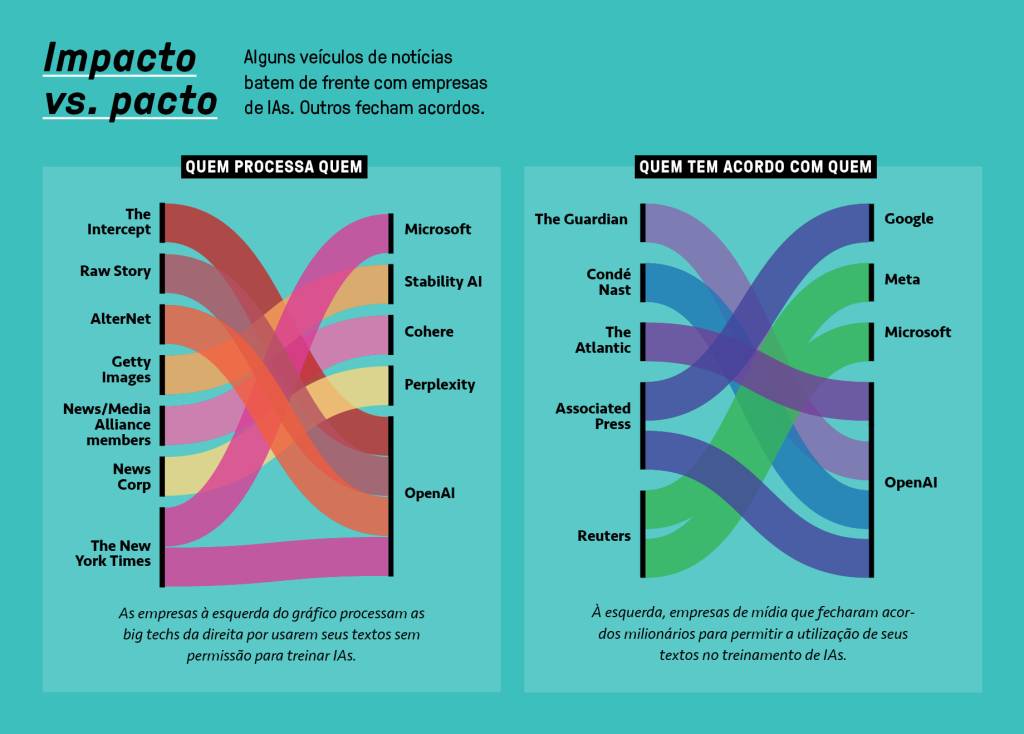

Processos assim, porém, vêm se tornando cada vez mais frequentes nos últimos dois anos. Já em 2023, o jornal The New York Times processou a OpenAI e a Microsoft, acusando-as de usar milhões de seus conteúdos sem permissão para treinar as várias encarnações do GPT. Sony, Universal e Warner também processaram a Udio e a Suno, IAs geradoras de músicas, por violação de direitos autorais – esses algoritmos, afinal, foram treinados ouvindo basicamente todas as canções da história registrada.

A Getty Images, um banco de imagens para uso editorial, acionou a Stability AI em janeiro, acusando a empresa de violação “descarada” de seu catálogo. Um grupo de pintoras, por sua vez, processa Midjourney, Stability AI e Deviant- Art – três plataformas que usaram suas obras sem permissão para treinar IAs geradoras de imagens. Programadores também se uniram contra a IA do GitHub (uma subsidiária da Microsoft), a Copilot.

Em suma, quase todas as grandes empresas de IA generativa já estão envolvidas em alguma briga judicial sobre os limites dos direitos autorais de obras criativas. Brigas que não sabemos como vão caminhar, porque essa é uma situação inédita na história humana. Juízes e advogados dos mais diversos países precisam aplicar as legislações de copyright preexistentes a um contexto novo, em que máquinas se tornaram capazes de fazer o que todo músico, artista plástico ou programador já fez – detectar padrões no trabalho alheio e aprender com eles.

Uso justo, uso injusto

Nas conversas entre funcionários da Meta que acabaram vindo a público, um diretor de engenharia da companhia explica qual seria o problema caso a empresa conseguisse licenciar apenas alguns dos livros usados para treinar a IA, mas não todos: posteriormente, ficaria mais difícil argumentar no tribunal que se trata de um caso de fair use (“uso justo”, em tradução livre). Dito e feito. No momento, a dona do Facebook não nega que tenha usado material pirateado, mas defende que essa ação é protegida pela tal doutrina do uso justo. A apuração é da revista The Atlantic, que foi a responsável por trazer o escândalo à tona.

Para entender essa cartada, façamos uma breve digressão sobre direitos autorais. Eles existem para conciliar dois objetivos conflitantes. De um lado, incentivar a produção de novas obras, já que os criadores têm garantia de que serão remunerados. Por outro lado, para permitir o acesso à cultura, o debate público e o desenvolvimento científico, deve haver limites sensatos. A lei protege a forma como as ideias são expressas – a sequência exata de palavras em um texto –, mas o uso das ideias em si é uma discussão mais sutil.

O que nos leva ao fair use, que é parte do Direito americano, mas não tem um equivalente exato no Brasil. Essa doutrina permite à pessoa acusada argumentar que usou o material protegido para fins de crítica, comentário, reportagem jornalística, ensino, pesquisa e outros usos claramente inofensivos e benéficos – inclusive para o próprio artista: de que adianta lançar um filme e impedir que a imprensa o comente?

Os tribunais dos EUA consideram quatro fatores para determinar se um uso é justo ou não: se a finalidade é comercial ou educacional, a natureza da obra protegida, a quantidade e a importância da parte utilizada (quantos e quais minutos de filme ou palavras de um livro você pode reproduzir) e o efeito sobre o valor de mercado da obra original (ou seja, se o uso em questão vai diminuir a remuneração do autor).

Pensando nesses critérios, um argumento central da defesa da Meta é que inteligências artificiais, via de regra, geram textos inéditos – que jamais repetirão um conteúdo preexistente palavra por palavra. Apesar da origem ilegal das obras que a IA precisou “ler” durante seu treinamento, não faria sentido dizer que suas criações infringem direitos autorais. Seria o equivalente a acusar um escritor de plágio porque ele aprendeu a escrever lendo outros escritores em PDFs pirateados – ou pegando as obras gratuitamente em uma biblioteca pública. Na prática, o tamanho dos trechos de uma obra que o LLaMA reproduz é zero.

Outra discussão central é a da grana. O juiz Vince Chhabria, que está conduzindo o caso dos autores contra a Meta, concorda que usar os livros no treinamento de uma IA não afeta de maneira demonstrável as vendas dessas obras: “Você [o advogado de acusação] parece estar me pedindo para especular que o mercado para uma autobiografia de Sarah Silverman [uma comediante famosa] será afetado pelos bilhões de coisas que o LLaMA será capaz de produzir, e não me parece que é o caso. […] Quando eu digito um prompt no LLaMA, eu não peço para ele fazer uma cópia do livro”.

Por outro lado, Chhabria admite que a IA é uma ameaça aos profissionais criativos como um todo: as IAs generativas podem até não infringir copyrights, mas já estão tirando vagas de redatores, ilustradores e outros profissionais no presente. “Se você está mudando drasticamente – talvez até obliterando – o mercado para a obra dessa pessoa, e está dizendo que nem precisa pagar uma licença a ela para usar seu trabalho na criação de um produto que está destruindo esse mercado, eu não entendo como isso pode ser considerado fair use.”

Um relatório recente da Confederação Internacional das Sociedades de Autores e Compositores (Cisac), por exemplo, prevê que o futuro de trabalhos criativos feitos por humanos está em risco devido às IAs generativas. De acordo com o documento, compositores e criadores de obras audiovisuais terão, respectivamente, 24% e 21% de suas receitas em risco de perda até 2028 – uma baixa acumulada de € 22 bilhões (R$ 141,57 bi) ao longo desse período.

Enquanto isso, as previsões indicam que o mercado de conteúdo musical e audiovisual gerado por IA aumentará exponencialmente nos próximos cinco anos, dos cerca de € 3 bilhões atuais (R$ 19 bi) para € 64 bilhões (R$ 234 bi) em 2028. O baque não aparece só nos números. Às vezes, um caso vale por mil estatísticas: no Sony World Photography Awards de 2023, o fotógrafo vencedor admitiu que sua imagem premiada foi gerada por IA.

Em suma: ninguém discute que a Meta foi antiética – e esse escândalo midiático é só mais um na longa lista de filmes queimados da empresa, o que não ajuda nas suas relações com as autoridades e com profissionais criativos mundo afora. Mas a possibilidade de puni-la no âmbito jurídico é outra história, já que o caso se encontra em uma fronteira nova e relativamente inexplorada do Direito.

A letra fria da lei

Não faltam esforços para alcançar essa fronteira. Na Declaração de Líderes do G20 de 2024, os representantes concordaram que deve haver um pagamento adequado aos proprietários de direitos autorais cujas obras sejam usadas para treinamento de IAs. Na União Europeia, o AI Act já estabelece regras de transparência e regula o uso de obras no treinamento, facilitando o licenciamento e o pagamento aos titulares. Austrália, Canadá e Espanha também discutem a aprovação de legislação sobre a matéria, e o Japão tem revisto a implementação de sua lei.

No Brasil, o Projeto de Lei 2338/2023, em discussão no Senado, tem o objetivo de regulamentar a IA no País – e inclui a obrigação de transparência sobre os dados utilizados para treinar modelos generativos. A legislação atual não prevê a possibilidade de um LLM ser considerado autor de uma obra. Por não se encaixar na definição legal de pessoa física, um software não tem direitos de personalidade. Porém, a Lei de Direitos Autorais (LDA) foi sancionada em 1998, em uma época em que não se imaginava criações artísticas desenvolvidas por algo não humano.

Para quem prefere não virar algoritmo, há algumas saídas: “Atualmente, já existem cláusulas contratuais específicas, como a no-AI training, que proíbem o uso de obras para fins de treinamento de inteligência artificial”, explica Caren Benevento, sócia da Benevento Advocacia e pesquisadora do Grupo de Estudos do Direito Contemporâneo do Trabalho e da Seguridade Social da USP.

Nos Estados Unidos, também há um projeto de lei com disposições semelhantes às discutidas aqui – e o estado da Califórnia, onde fica o Vale do Silício, já estabelece a obrigação de transparência sobre os conteúdos utilizados em sistemas de IA.

Vale dizer que nem toda empresa que trabalha com LLMs tenta ganhar a briga na Justiça à moda Meta. A OpenAI, por exemplo, teria oferecido a empresas de mídia e jornais algo entre US$ 1 milhão e US$ 5 milhões por ano para licenciar reportagens, artigos etc. protegidos por direitos autorais e treinar seus modelos. Um acordo com a News Corp. – dona de gigantes como o Wall Street Journal e a editora HarperCollins –, bateu US$ 250 milhões por cinco anos de uso.

Em 2020, o Google seguiu o mesmo caminho e anunciou que investiria US$ 1 bilhão em parcerias com organizações de notícias. Além disso, também concordou recentemente em pagar a editoras canadenses um total de US$ 100 milhões anuais.

Em longo prazo, é possível vislumbrar uma situação jurídica menos incerta para o setor de IA – em que existam leis cada vez mais específicas e eficazes para regular o setor, e as big techs se sintam cada vez mais pressionadas a reconhecer sua dívida com os profissionais criativos (nem que seja com a intenção egoísta de sair da mira de jornalistas investigativos e manifestantes revoltados).

Criadores e criaturas

Isso não mudará, porém, a discussão mais ampla sobre o lugar das IAs generativas nas artes. O exemplo mais recente e marcante dessa polêmica foi a trend do Studio Ghibli, em que usuários de redes sociais por todo o mundo utilizaram um update recém-lançado do ChatGPT para transformar fotos de si próprios e de entes queridos em desenhos no estilo da célebre produtora de animação japonesa.

Estima-se que, no auge da modinha, mais de 40 milhões de ilustrações foram geradas por dia. Em uma única hora, a versão atualizada do serviço da OpenAI atraiu 1 milhão de novos usuários – superando com folga o recorde anterior da empresa, que demorou cinco dias para atingir a mesma marca quando lançou a encarnação original do chatbot, em 2022.

Cada imagem gerada consome, em média, 1 watt-hora (Wh) de energia, o que significa um gasto diário de 40 megawatt-horas (MWh) – o suficiente para abastecer mais de 7 mil residências brasileiras por um dia inteiro, estima a MIT Technology Review Brasil. “Isso é um pouco excessivo. Talvez não precisemos explorar tantos recursos apenas para chegar a esses tipos de resultados”, diz Annette Zimmermann, filósofa política que trabalha com ética de inteligência artificial.

Muito antes, em 2016, o fundador do Studio Ghibli, Hayao Miyazaki, já havia se posicionado contra o uso da inteligência artificial em criações artísticas, carinhosamente (rs) apelidando o ato de “um insulto à vida”. O problema: um estilo de ilustração não é algo que possa ser explicitamente protegido por direitos autorais, o que significa que a OpenAI não infringe a lei ao gerar imagens que parecem com os filmes de Miyazaki.

Mark Coeckelbergh, autor do livro Ética na Inteligência Artificial, não acha que negar a realidade é um caminho plausível: a tecnologia veio para ficar. O que precisamos é “regulamentar as big techs, fazer as coisas de maneiras mais transparentes e garantir que os autores sejam recompensados”.

Para Coeckelbergh, há espaço para trabalhos em que humanos e máquinas fazem algo genuinamente criativo juntos. No entanto, esse futuro só é alcançável com políticas de código aberto, remuneração às propriedades privadas utilizadas no treinamento de modelos de linguagem e o reconhecimento dos trabalhos usados. Todos esses pontos constam da carta que os manifestantes de abril pretendiam entregar à Meta. Eles seguem ignorados. Até a data de conclusão deste texto, o processo dos sete americanos contra a empresa de Zuckerberg permanecia em aberto.

Fontes: Marcelo Prates, Doutor em Ciência da Computação com ênfase em Aprendizado de Máquina pela Universidade Federal do Rio Grande do Sul (UFRGS); Marcos Breder Pinheiro, autor do livro Geração IA; Wadson Amorim, professor de design na Universidade do Estado de Minas Gerais.

Hipótese “maluca” sobre Plutão é confirmada pelo James Webb

Hipótese “maluca” sobre Plutão é confirmada pelo James Webb A transição demográfica e a longevidade são conquistas históricas

A transição demográfica e a longevidade são conquistas históricas Por que o Irã não se chama mais Pérsia?

Por que o Irã não se chama mais Pérsia? O que é a geada negra?

O que é a geada negra? Qual a diferença entre jumento, mula, burro, jegue, asno…

Qual a diferença entre jumento, mula, burro, jegue, asno…