Inteligência artificial recria o que pessoas viram a partir de exames cerebrais

Pesquisadores treinaram um algoritmo com ressonâncias magnéticas de quatro voluntários, realizadas enquanto eles observavam uma galeria de 10 mil imagens.

Pesquisadores da Osaka University, no Japão, demonstraram que modelos de inteligência artificial que transformam textos em imagens (como o DALL-E) podem interpretar as varreduras cerebrais de um indivíduo e recriar versões realistas das imagens que aquela pessoa viu, como objetos e fotos de paisagens.

No futuro, com mais refinamentos, essa tecnologia pode ter aplicações variadas: estudar como várias espécies animais percebem o mundo, auxiliar na comunicação de pessoas com paralisia ou, talvez, registrar sonhos humanos.

Outros grupos de pesquisa já geraram imagens a partir de sinais cerebrais usando modelos de inteligência artificial que exigem o ajuste de milhões (ou bilhões) de variáveis internas e consomem um bocado de energia. Mas o novo método é baseado no gerador de imagens Stable Diffusion (lançado pela Stability AI em agosto de 2022) e envolve menos variáveis – milhares, em vez de milhões. Por exigir menos ajustes e poder ser treinado com um conjunto de dados menor, os pesquisadores dizem que o sistema é mais eficiente que os anteriores.

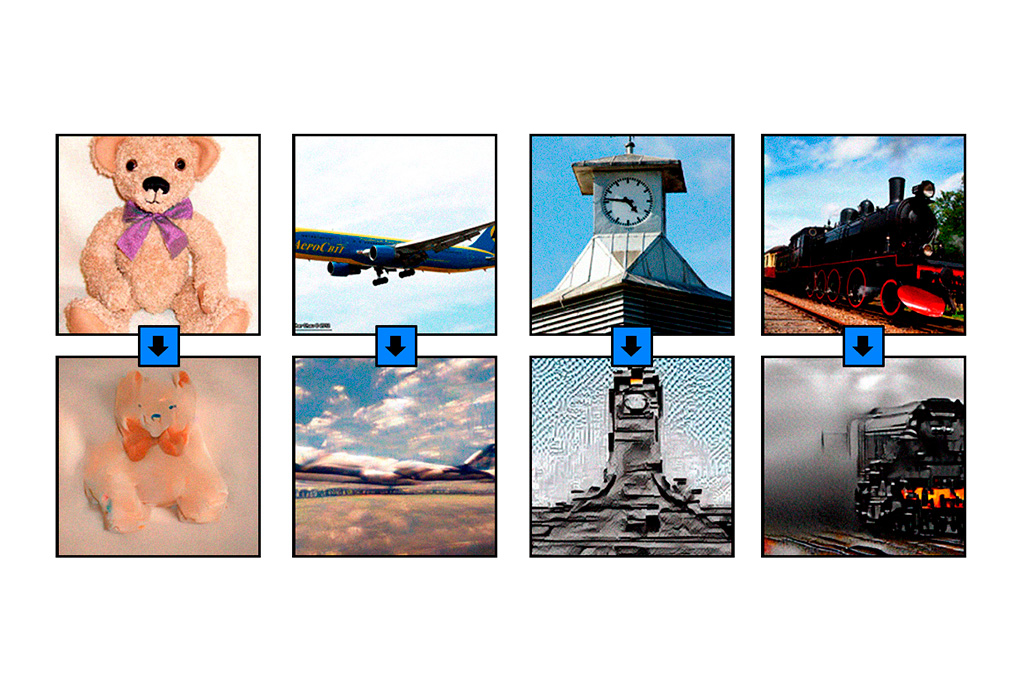

Caso você ainda não tenha brincado com uma inteligência artificial geradora de imagens, ela funciona assim: você escreve o que quer ver – um ursinho de pelúcia, por exemplo – e a IA cria aquilo. Só que, diferente de um Google Imagens, aquele ursinho de pelúcia é inédito, feito unicamente para você. Ou seja: a IA “interpreta” as suas palavras para chegar no resultado visual.

O que os pesquisadores fizeram foi trocar as palavras por varreduras cerebrais, que são exames de ressonância magnética do cérebro. É como se esses exames fossem uma “linguagem” que nós, humanos, não sabemos ler – mas que a IA aprendeu.

Shinji Nishimoto e Yu Takagi, autores do estudo que ainda será revisado por pares, treinaram o algoritmo para interpretar um conjunto de dados fornecidos pela Universidade de Minnesota (Estados Unidos). Eram exames cerebrais de ressonância magnética de quatro voluntários, realizados enquanto cada um deles observava uma galeria de 10 mil imagens.

Tais exames detectam alterações no fluxo sanguíneo para regiões ativas do cérebro; neste caso, o lobo occipital e o lobo temporal, que são importantes para o processamento de estímulos visuais. As informações processadas por estas regiões do cérebro são também registradas pela ressonância à medida que ela captura picos na atividade cerebral.

Os pesquisadores vincularam descrições de texto às imagens e usaram 90% destes dados (imagens + exames) para treinar o algoritmo. Os outros 10% serviram para testar o sistema. No fim, deu certo: a IA converteu os padrões da atividade cerebral dos voluntários em imagens semelhantes às que eles viram durante os exames, como fotografias de um urso de brinquedo, avião, relógio e trem. Cerca de mil imagens que as pessoas visualizaram foram reconstruídas com 80% de precisão.

A seguir, veja a imagem que o participante observou (acima) e a imagem gerada pela IA (abaixo).

Mas não fique animado achando que você vai comprar um leitor de mentes em breve: esse sistema precisa ser personalizado para cada indivíduo. Ou seja: para funcionar com o seu cérebro ele precisaria ser treinado com suas varreduras cerebrais.

Vídeo de lobo selvagem roubando armadilha pode ser primeiro registro de uso de ferramentas na espécie

Vídeo de lobo selvagem roubando armadilha pode ser primeiro registro de uso de ferramentas na espécie “Adolescência” pode ir até os 32 anos, indica estudo que descreve cinco fases do cérebro

“Adolescência” pode ir até os 32 anos, indica estudo que descreve cinco fases do cérebro Últimas ararinhas-azuis da natureza são diagnosticadas com vírus letal – comprometendo o futuro da espécie

Últimas ararinhas-azuis da natureza são diagnosticadas com vírus letal – comprometendo o futuro da espécie Estudo sugere que pombos percebem o campo magnético da Terra pelos ouvidos

Estudo sugere que pombos percebem o campo magnético da Terra pelos ouvidos Seu nome está no ranking? Saiba como explorar a nova plataforma Nomes do Brasil

Seu nome está no ranking? Saiba como explorar a nova plataforma Nomes do Brasil